В четверг Apple представила изменения в iPhone, предназначенные для выявления случаев сексуального насилия над детьми, что, вероятно, понравится родителям и полиции но это уже беспокоило сторожевые псы.

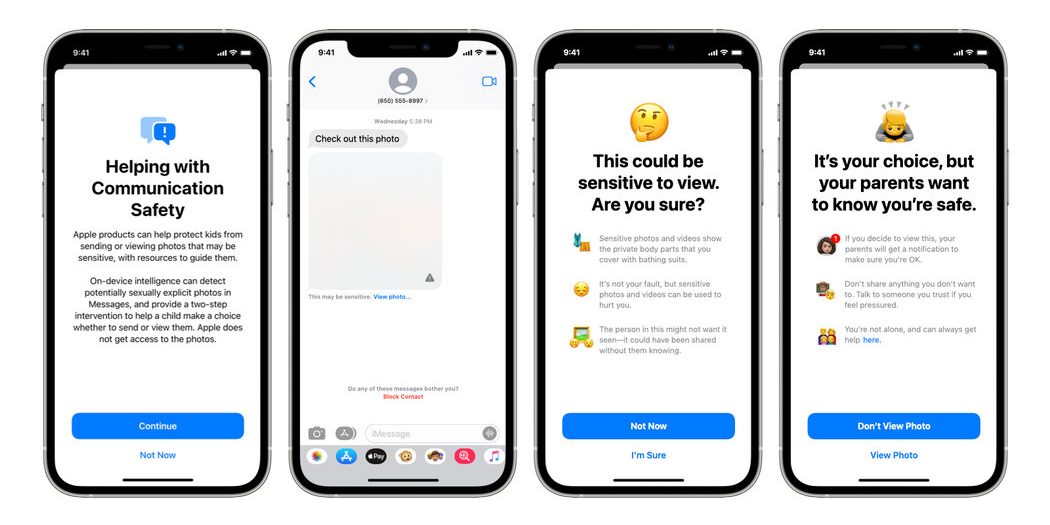

Позже в этом году в iPhone начнут использоваться сложные технологии для обнаружения изображений сексуального насилия над детьми, широко известных как детская порнография, которые пользователи загружают в службу хранения Apple iCloud, сообщила компания. . Apple также заявила, что вскоре позволит родителям включить функцию, которая может отмечать, когда их дети отправляют или получают какие-либо обнаженные фотографии в текстовом сообщении.

Apple заявила, что разработала новые функции таким образом, чтобы защитить конфиденциальность пользователей, в том числе гарантируя, что Apple никогда не увидит и не узнает о каких-либо изображениях обнаженной натуры, которыми обмениваются дети в текстовых сообщениях. Сканирование выполняется на устройстве ребенка, а уведомления отправляются только на устройства родителей. Apple предоставила цитаты некоторых экспертов по кибербезопасности и групп по безопасности детей, в которых хвалят подход компании.

Другие эксперты по кибербезопасности все еще были обеспокоены. Мэтью Д. Грин, профессор криптографии Университета Джона Хопкинса, сказал, что новые функции Apple создают опасный прецедент, создавая технологию наблюдения, которую могут использовать правоохранительные органы или правительства.

«Они продают миру конфиденциальность и заставляют людей доверять своим устройствам», — сказал г-н Грин. «Но теперь они по сути капитулируют перед наихудшими требованиями любого правительства. Я не понимаю, как они собираются отказываться от этого ».

Хотя материал появился еще до Интернета, такие технологии, как камеры смартфонов и облачное хранилище, позволили изображениям распространяться. быть более широко распространенным. Некоторые образы циркулируют годами, продолжая травмировать и преследовать изображенных людей.

Но смешанные обзоры новых функций Apple показывают тонкую грань, которую технологические компании должны пройти между содействием общественной безопасности и обеспечением конфиденциальности клиентов. Сотрудники правоохранительных органов в течение многих лет жаловались, что такие технологии, как шифрование смартфонов, затрудняют уголовные расследования, в то время как руководители технических служб и эксперты по кибербезопасности утверждали, что такое шифрование имеет решающее значение для защиты данных и конфиденциальности людей.

В заявлении в четверг Apple попыталась проденьте нить в эту иглу. Он сказал, что разработал способ помочь искоренить детей-хищников, который не поставил под угрозу безопасность iPhone.

Чтобы обнаружить материалы сексуального насилия над детьми, или CSAM, загружены Для iCloud iPhone будет использовать технологию, называемую хэшем изображений, сообщила Apple. Программа превращает фотографию в уникальный набор цифр — своего рода отпечаток пальца изображения.

Позвольте нам помочь вам Защитите свою цифровую жизнь

В операционной системе iPhone скоро будет храниться база данных хэшей известных материалов о сексуальном насилии над детьми, предоставленная таких организаций, как Национальный центр пропавших без вести и эксплуатируемых детей, и он будет сравнивать эти хэши с хешами каждой фотографии в iCloud пользователя, чтобы проверить, есть ли совпадения.

Когда есть определенное количество совпадений, фотографии будут показаны сотруднику Apple, чтобы убедиться, что они действительно представляют собой изображения сексуального насилия над детьми. Если это так, они будут отправлены в Национальный центр пропавших без вести и эксплуатируемых детей, а учетная запись iCloud пользователя будет заблокирована.

Apple заявила, что такой подход означает, что люди, не имеющие материалов о сексуальном насилии над детьми на своих телефонах, не смогут их фотографии видели Apple или представители властей.

«Если вы храните коллекцию CSAM материал, да, это плохо для вас », — сказал Эрик Нойеншвандер, руководитель службы конфиденциальности Apple. «Но для остальных из вас это ничем не отличается».

Система Apple не сканирует видео, загруженные в iCloud, даже несмотря на то, что преступники использовали этот формат годами. В 2019 году в национальный центр впервые было отправлено видео, которое превысило количество фотографий. Центр часто получает несколько отчетов об одном и том же содержании.

U.S. Закон требует, чтобы технологические компании сообщали властям о случаях сексуального насилия над детьми. Apple исторически регистрировала меньше случаев, чем другие компании. В прошлом году, например, Apple сообщила о 265 случаях в Национальный центр пропавших без вести и эксплуатируемых детей, а Facebook сообщил о 20,3 миллионах, согласно статистике центра. Этот огромный пробел частично связан с решением Apple не сканировать такие материалы, ссылаясь на конфиденциальность своих пользователей.

Другая функция Apple, которая сканирует фотографии в текстовые сообщения будут доступны только семьям с совместными учетными записями Apple iCloud. Если родители включат его, iPhone их ребенка проанализирует каждую фотографию, полученную или отправленную в текстовом сообщении, чтобы определить, есть ли на ней изображение наготы. Фотографии в стиле ню, отправленные ребенку, будут размыты, и ребенку придется выбирать, просматривать ли их. Если дети младше 13 лет захотят просмотреть или отправить фотографию в обнаженном виде, их родители будут уведомлены об этом.

Mr. Грин сказал, что он обеспокоен тем, что такой системой могут злоупотреблять, поскольку она показывает правоохранительным органам и правительствам, что у Apple теперь есть способ пометить определенный контент на телефоне, сохранив при этом его шифрование. Apple ранее заявляла властям, что шифрование не позволяет получить определенные данные.

«Что происходит, когда другие правительства просят Apple использовать это для других целей?» — спросил мистер Грин. «Что Apple собирается сказать?»

Нойеншвандер отверг эти опасения, заявив, что существуют меры предосторожности для предотвращения злоупотреблений системой и что Apple отклонит любые такие требования правительства.

«Мы сообщим им, что мы не создавали то, что они

Хани Фарид, профессор информатики в Калифорнийском университете в Беркли, который помог разработать раннюю технологию хэширования изображений, сказал, что любые возможные риски в подходе Apple стоят безопасности детей.

« Если будут приняты разумные меры предосторожности, я думаю, что преимущества перевесят недостатки », — сказал он.

Майкл Х. Келлер и Габриэль Дж. Х Дэнс представили отчеты

.