Эта статья является частью информационного бюллетеня On Tech . Вы можете зарегистрироваться здесь чтобы получать его по будням.

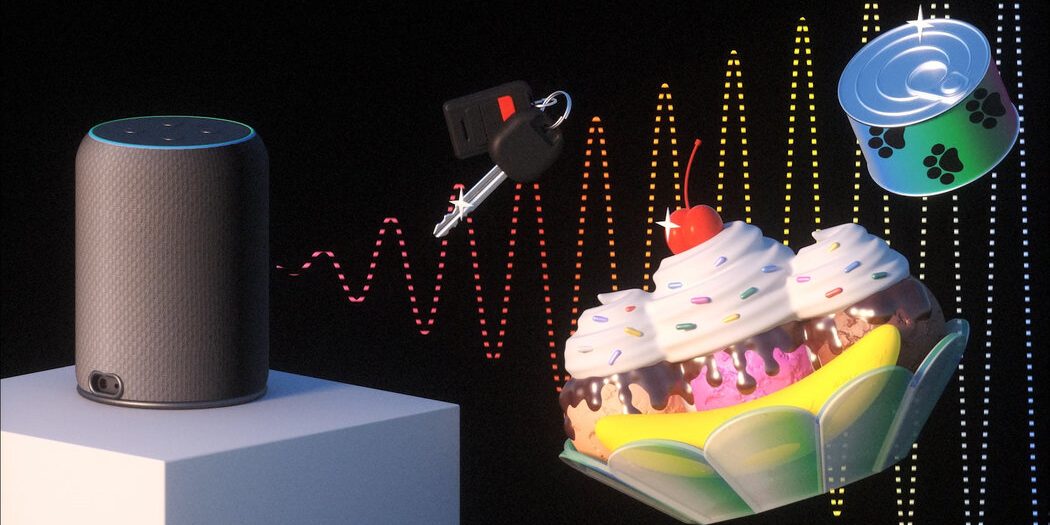

Если Алекса считает, что вам грустно, вам нужно купить галлон мороженого ?

Джозеф Туроу не говорит ни в коем случае. Доктор Туроу, профессор Школы коммуникации Анненберга при Пенсильванском университете, исследовал такие технологии, как Алекса, для своей новой книги «Улавливатели голоса». Он ушел с убеждением, что компаниям следует запретить анализировать то, что мы говорим и как мы звучим, чтобы рекомендовать продукты или персонализировать рекламные сообщения.

Dr. Предложение Туроу примечательно отчасти потому, что профилирование людей на основе их голосов не получило широкого распространения. Или еще нет. Но он побуждает политиков и общественность делать то, что я хотел бы, чтобы мы делали чаще: будьте осторожны и внимательны к тому, как мы используем мощную технологию, прежде чем ее можно будет использовать для принятия последующих решений.

После многих лет исследований американцев » д-р Туроу сказал, что, развивая отношение к нашим цифровым струйным потокам персональных данных, некоторые виды использования технологий имеют настолько большой риск для столь незначительного роста, что их следует прекратить, прежде чем они станут популярными.

В данном случае доктор Туроу обеспокоен тем, что голосовые технологии, включая Alexa и Siri от Apple, превратятся из цифровых дворецких в прорицателей, которые используют звук наших голосов для проработки таких интимных деталей, как наше настроение, желания и медицинские условия. Теоретически они могут однажды использоваться полицией, чтобы определить, кого следует арестовать, или банками, чтобы сказать, кто достоин ипотеки.

«Использование человеческого тела для дискриминации людей — это то, чего мы не должны делать. — сказал он.

Некоторые бизнес-центры, например, центры обработки вызовов, уже делают это. Если компьютеры определят, что вы говорите по телефону в гневе, вас могут перенаправить к операторам, которые специализируются на успокоении людей. Spotify также раскрыл патент на технологию чтобы рекомендовать песни, основанные на голосовых подсказках об эмоциях, возрасте или поле говорящего. Amazon заявила, что ее браслет и сервис для отслеживания состояния здоровья Halo будут анализировать «энергию и позитив в голосе клиента», чтобы подтолкнуть людей к лучшему общению и отношениям.

Dr. Туров сказал, что он не хотел прекращать потенциально полезное использование голосового профилирования — например, для проверки людей на наличие серьезных заболеваний, включая Covid-19. Но для нас очень мало пользы, сказал он, если компьютеры используют выводы из нашей речи, чтобы продавать нам средство для мытья посуды.

«Мы должны объявить голосовое профилирование вне закона в целях маркетинга», — сказал мне доктор Туроу. . «Нет никакой пользы для общества. Мы создаем еще один набор данных, которые люди не имеют ни малейшего представления о том, как они используются ».

Dr. Туров участвует в дебатах о том, как обращаться с технологиями, которые могут иметь огромные преимущества, но также и недостатки, которые мы, возможно, не увидим. Должно ли правительство пытаться установить правила и нормы вокруг мощных технологий, прежде чем они станут широко использоваться, как, например, в Европе, или оставить их в покое, если не случится чего-то плохого?

Сложность заключается в том, что когда такие технологии, как программное обеспечение для распознавания лиц или поездки на автомобиле по нажатию кнопки смартфона, становятся распространенными, становится труднее отказываться от функций, которые оказываются вредными.

I не знаю, прав ли доктор Туроу, когда бьет тревогу по поводу того, что наши голосовые данные используются в маркетинговых целях. Несколько лет назад было много шумихи о том, что голос станет основным способом, с помощью которого мы будем делать покупки и узнавать о новых продуктах. Но никто не доказал, что слова, которые мы говорим нашим вещам, являются эффективными предикторами того, какой новый грузовик мы купим.

Я спросил доктора Туроу, должны ли люди и государственные регулирующие органы беспокоиться о гипотетических рисках, которые могут никогда не приходи. В большинстве случаев чтение мыслей по голосам может не сработать, и нам не нужно больше вещей, чтобы волноваться.

Dr. Туров признал эту возможность. Но я поддержал его точку зрения о том, что стоит начать публичный разговор о том, что может пойти не так с голосовой технологией, и вместе решить, где находятся наши общие красные линии — до того, как они будут пересечены.

Прежде, чем мы уйдем…

-

Насилие со стороны толпы усилилось с помощью приложения: В Израиле, по крайней мере, 100 новых WhatsApp Как сообщила моя коллега Шира Френкель группы были созданы специально для организации насилия против палестинцев. По словам Ширы, люди редко использовали WhatsApp для такого целенаправленного насилия.

-

И когда приложение поощряет дружинников: Citizen, приложение, которое предупреждает людей о преступлениях в районе и опасностей, опубликовал фотографию бездомного и предложил вознаграждение в размере 30 000 долларов за информацию о нем, заявив, что он подозревался в организации лесного пожара в Лос-Анджелесе. Действия гражданина помогли начать охоту на человека, которого полиция позже назвала не тем человеком, написала моя коллега Дженни Гросс.

-

Почему во многих популярных видео TikTok такое же Мягкая атмосфера: Это интересная статья Vox о том, как компьютерное приложение вознаграждает видео «в запутанной медиане самых средних вкусов всех людей на земле».

] Обнимаю

Вот не-бла-видео в TikTok со счастливой лошадью и несколькими счастливыми щенками.

Мы хотим услышать ваше мнение. Расскажите нам, что вы думаете об этом информационном бюллетене и что еще вы хотели бы, чтобы мы изучили. Вы можете связаться с нами по адресу ontech@nytimes.com.

Если вы еще не получили этот информационный бюллетень в своем почтовом ящике, пожалуйста, подпишите здесь . Вы также можете прочитать прошлые колонки On Tech .