Джон П. Мелло-младший

9 марта 2021 г., 4:22 утра по тихоокеанскому времени

Скептикам в отношении предоставления компьютерам контроля над деятельностью повышенного риска, такой как вождение автомобиля, на прошлой неделе дали немного боеприпасов, когда исследователи из OpenAI обнаружили, что их двухмесячную систему машинного зрения можно обмануть ручкой и бумагой, чтобы они не распознавали объекты.

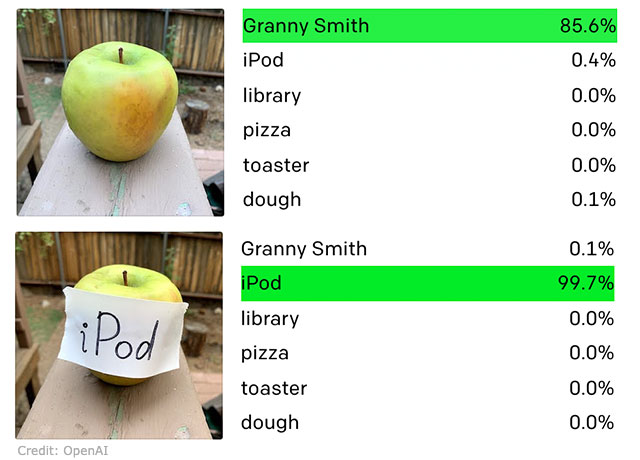

4 марта лаборатория искусственного интеллекта опубликовала документ, в котором говорилось, что их новую систему можно обмануть, чтобы идентифицировать яблоко как iPod, прикрепив к яблоку записку со словом iPod.

В другом случае система также определила бензопилу как копилку, когда знаки доллара были разбросаны по фотографии инструмента.

Несмотря на эти ошибки, OpenAI сохраняет оптимизм в отношении своей экспериментальной системы машинного зрения, называемой CLIP, которая исследует, как системы искусственного интеллекта могут идентифицировать объекты без тщательного наблюдения посредством обучения с большими базами данных пар изображений и текста.

Исследователи компании объяснили в блоге, что они обнаружили присутствие мультимодальных нейронов в CLIP. В человеческом мозге эти нейроны реагируют на группы абстрактных понятий, сосредоточенных вокруг общей высокоуровневой темы, а не на какие-либо конкретные визуальные особенности.

«Наше открытие мультимодальных нейронов в CLIP дает нам ключ к пониманию того, что может быть общим механизмом как синтетических, так и естественных систем зрения — абстракции», — написал исследователь.

Содержание статьи

Новая поверхность атаки

Однако способность системы связывать слова и изображения на абстрактном уровне также создала новый вектор атаки, ранее не замеченный в системах машинного зрения.

«Используя способность модели надежно читать текст, мы обнаруживаем, что даже фотографии рукописного текста часто могут обмануть модель», — отметили исследователи.

Подобные атаки с использованием «состязательных изображений» использовались против коммерческих систем машинного зрения, но с CLIP они не требуют больше технологий, чем ручка и бумага.

Конструктивные недостатки систем машинного зрения, таких как CLIP, не являются чем-то необычным.

«Системы машинного обучения очень часто имеют недостатки в способах классификации объектов», — заметил Джонатан Спринг, аналитик из отдела CERT Института программной инженерии Университета Карнеги-Меллона в Питтсбурге.

«Вы не всегда можете предсказать, что будет делать компьютер, даже если вы знаете, для чего он был запрограммирован», — сказал он TechNewsWorld.

Обманите машину, отвлекающую

Люди не до конца понимают, как они обрабатывают мир с помощью визуальных стимулов, но они пытаются научить машину, как это делать, — объяснил Вилас Дхар, президент Фонда Патрика Дж. Макговерна, базирующегося в Бостоне, который занимается изучением влияния искусственного интеллекта и науки о данных на общество.

«Это означает, что мы сокращаем путь», — сказал он TechNewsWorld. «Вместо того, чтобы объяснять системе, что такое яблоко как концептуальный объект с присущим ему значением, мы рассматриваем его как конфигурацию пикселей, образец, который приобретает смысл через контекст».

«Этот подход работает в большинстве случаев. время, но может сильно потерпеть неудачу, если контекст не является частью обучающей выборки », — продолжил он. «Когда мы обучаем бессмысленные системы машинного зрения, мы уходим дальше от реальности машин, которые беспрепятственно перемещаются в нашей реальной искусственной среде».

Кьелл Карлссон, главный аналитик Forrester Research, предупредил, что нас отвлекают обманом. -машинные истории.

«Абсолютно важно, чтобы люди исследовали ограничения этих моделей, но тот факт, что вы можете обмануть модель, сам по себе ничего полезного не говорит», — сказал он TechNewsWorld.

«Например, людей невероятно легко обмануть», — продолжил он. «Люди систематически думают, что люди в очках умны, и в нашем распоряжении около 86 миллиардов биологических нейронов».

Тонкая подделка

Майк Джуд, директор по исследованиям приложений видеонаблюдения и машинного зрения в IDC, объяснил, что системы машинного зрения можно подделать, играя на предубеждениях, которые подразумеваются в обучении, которое входило в сеть.

«Можно сделать то же самое с человеком», — сказал он TechNewsWorld.

«С системой машинного зрения все может быть намного более тонким», — продолжил он. «В изображение могут быть встроены реплики, которые человеческий глаз не может воспринимать, но компьютер может, потому что он просто смотрит на пиксели».

«Любую систему машинного зрения можно взломать», — добавил он. «В любой системе есть недостатки, которые можно использовать с помощью правильной атаки».

«Это подтверждает некоторые опасения людей по поводу приложений машинного зрения», — сказал он.

Критично для беспилотных автомобилей

Одной из областей, вызывающих особую озабоченность, является использование машинного зрения в беспилотных транспортных средствах.

«Машинное зрение абсолютно необходимо для беспилотных автомобилей», — заявил Сэм Абуэлсамид, главный аналитик по электронной мобильности в Guidehouse Insights, компании по анализу рынка в Детройте.

«Это критически важно, потому что система должна не только классифицировать, где находятся объекты вокруг транспортного средства, но и что это за объекты, чтобы принимать решения о том, что делать, точно так же, как мы, как водители-люди», — сказал он TechNewsWorld.

«Если пластиковый пакет летит через дорогу, это не риск, но если ребенок находится в дороге, это большой риск», — добавил он.

Он объяснил, что транспортное средство должно понимать семантику того, что видят датчики, поэтому точная классификация обнаруживаемых объектов абсолютно необходима для безопасности и надежности автоматизированной системы вождения.

Автоматизированные системы вождения, которые чрезмерно полагаются на машинное зрение, обычно не очень надежны, утверждал он.

«Системы машинного зрения по-прежнему имеют много недостатков, особенно те, которые зависят от ИИ и нейронных сетей», — сказал он. «Все успешные системы восприятия для автоматизированного вождения используют несколько систем для понимания окружающей среды вокруг транспортного средства».

«Они используют сочетание машинного зрения и детерминированных датчиков, которые измеряют положение и расстояние до объектов», — продолжил он. . «Вам нужны радар, лидар и тепловизор, чтобы получить точное представление о том, что там происходит».

Хотя система CLIP OpenAI была описана как «современная», Абуельсамид скептически отнесся к ней. описание. «Любая система машинного зрения, которую обманывают запиской, не является самой современной», — возразил он.

Повышение безопасности и надежности

Спринг отметил, что есть способы сделать системы машинного зрения более безопасными и надежными.

«Существуют испытательные стенды для людей, которые хотят обучить свои модели машинного обучения и усложнить их атаки, но это никогда не избавит от всех атак», — заметил он.

«Нам также нужна социальная система на вершине технической системы, где мы можем управлять тем, что люди знают об обмане этих систем, и если есть недостатки с большим влиянием, нам нужны способы их обновления, чтобы избавиться от этих недостатков, " он продолжил. «Это похоже на то, как мы обрабатываем уязвимости в программном обеспечении в целом».

«Затем есть глубокая защита, поэтому у вас есть системы, которые помогают системе машинного обучения справляться с вероятными сбоями или обманом. ," добавил он. «Иногда это может быть человек, контролирующий систему. В других случаях это могут быть физические ограничения робота или автомобиля, которые не позволяют ему делать определенные вещи». ![]()