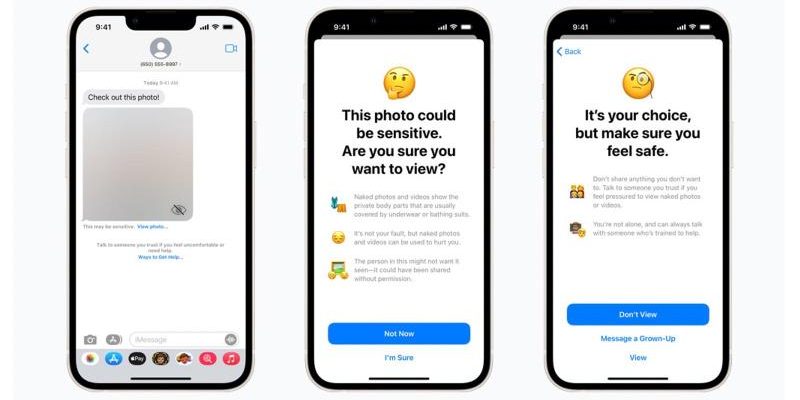

В понедельник, 13 декабря 2021 года, Apple выпустила финальную версию iOS 15.2. Компания закрыла несколько уязвимостей системы безопасности с помощью обновления и представила некоторые новые функции, в том числе новые средства защиты для детей, которые включают предупреждение о явном содержании в iMessage и защиту для поиска через Siri, Spotlight и Safari. Об этих изменениях компания объявила ранее, в 2021 году.

Средства защиты означают, что в iOS 15.2 родители могут активировать предупреждения, если их дети получат или отправят откровенный контент.

Изменения подробно описаны на веб-странице Apple, посвященной безопасности детей, но в сообщении Reddit отмечается, что с этой страницы исчез раздел: объявление об обзоре CSAM фотографий iCloud.

Страница Apple, посвященная будущим функциям безопасности детей, изначально была запущена 5 августа. Последняя версия датирована 13 декабря, и из нее удалены все ссылки на информацию, относящуюся к обзору CSAM. Соответствующий абзац на странице ранее был наиболее полным из трех функций безопасности. Кроме того, Apple сослалась на техническую документацию, такую как официальные документы и обзоры инноваций исследователями. Сами эти PDF-файлы все еще находятся в сети, но теперь ссылки со страницы объявления отсутствуют.

Apple получила негативную реакцию из-за своего объявления о том, что она будет проверять фотографии iCloud на предмет изображений, которые представляют материалы о сексуальном насилии над детьми. Людей явно больше беспокоило то, что это будет вторжением в их частную жизнь, чем способом защитить детей. Но не каждый пользователь Apple — родитель. Крейг Федериги из Apple объяснил, что сканирование фотографий Apple было «широко неправильно понято» в интервью Wall Street Journal в августе.

Затем в сентябре 2021 года компания обновила свою веб-страницу по безопасности детей, добавив:

«Ранее мы объявили о планах в отношении функций, направленных на защиту детей от хищников, использующих средства коммуникации для вербовки и эксплуатации детей, а также для ограничения распространения материалов о сексуальном насилии над детьми. Основываясь на отзывах клиентов, правозащитных групп, исследователей и с другой стороны, мы решили выделить дополнительное время в ближайшие месяцы, чтобы собрать информацию и внести улучшения, прежде чем выпускать эти критически важные функции безопасности детей ».

А сейчас планы Apple на этот счет пока неясны. Планы все еще откладываются или они больше не планируются.

Надеюсь, Apple найдет способ идентифицировать такого рода криминальные материалы, которые пользователи Apple не считают вторжением в свою личную жизнь.

Эта статья изначально была опубликована на Macwelt. Перевод Карен Хаслам.